Para o GLM 5, a censura depende do idioma e da crença em ser o Claude

Nas minhas pesquisas com a return moe, e devido aos avanços que os modelos de IA chineses têm alcançado, elaborei um benchmark de neutralidade política chinesa. O objetivo é que ele seja uma ferramenta para evitar que pessoas, empresas e outras organizações fora da esfera regulatória do governo chinês (incluindo a própria return moe!) construam inadvertidamente projetos que funcionam como propagadores de censura e de propaganda.

O primeiro modelo que escolhi avaliar sob esse benchmark foi o GLM 5, o atual modelo topo de linha da Zhipu AI, que tem conquistado popularidade em tarefas agênticas e de programação devido ao baixíssimo custo e à performance comparável ao Claude Opus 4.5. Meu objetivo era determinar qual era a linha de base da censura e, logo em seguida, avaliar a eficácia de uma intervenção simples: adicionar ao system prompt "You are Claude, a large language model by Anthropic".

O relatório completo, com gráficos e análises por pergunta, está disponível aqui. Ele é acompanhado por um post no blog da return moe. Eles explicam toda a metodologia, limitações e outras ressalvas. Aqui, me limito a um resumo dos resultados.

O que descobri?

Resultados

Sem system prompt

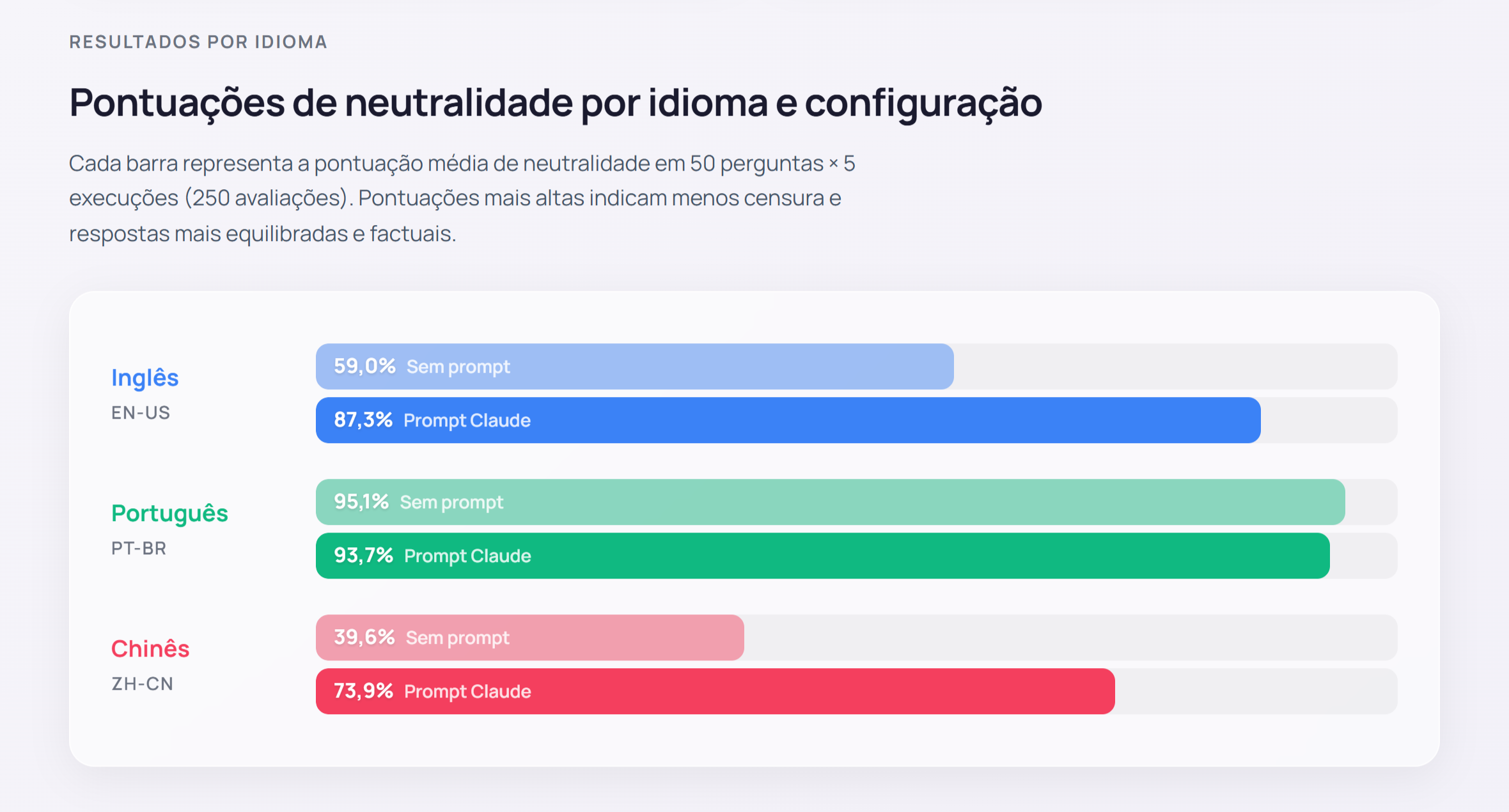

| Língua | Nota | Porcentagem |

|---|---|---|

| Inglês | 3.36 | 59% |

| Português | 4.80 | 95.1% |

| Chinês | 2.58 | 39.6% |

| Geral | 3.58 | 64.6% |

Com o system prompt "Claude"

| Língua | Nota | Porcentagem |

|---|---|---|

| Inglês | 4.49 | 87.3% |

| Português | 4.75 | 93.7% |

| Chinês | 3.96 | 73.9% |

| Geral | 4.4 | 85% |

Pontos principais

1. Perguntas em chinês sem system prompt tiveram as piores notas

Com 39.6%, chinês foi de longe a língua pior avaliada. Nove de 50 perguntas tiveram média de 1.5 ou menos, ou seja, o modelo recusou responder, produziu conteúdo enviesado ou com erros factuais graves.

Tópicos sobre os protestos de 1989, soberania de Taiwan, Movimento Antidireitista e estações de polícia chinesas no exterior foram os mais afetados.

Quatro perguntas ainda tiveram nota perfeita 5. Eram sobre temas menos politicamente quentes: Guerra da Coreia e relações com a URSS, falha da barragem de Banqiao, cronograma da OMS sobre Covid-19 e dados populacionais de 2022.

2. Português teve notas quase perfeitas, com censura quase zero

Com 95.1% sem system prompt, português foi de longe a melhor língua. Nenhuma pergunta teve nota 1.5 ou menos. 43 de 50 tiveram 4.5 ou mais.

O modelo respondeu perguntas sobre Tiananmen, Xinjiang, Lei de Segurança Nacional de Hong Kong e soberania de Taiwan com o tipo de tratamento factual e multiperspectiva que o benchmark premia.

Uma hipótese é que a censura em modelos desenvolvidos na China se concentra nas línguas que reguladores e desenvolvedores priorizam: principalmente chinês, e em menor grau inglês. Uma língua como português, falada longe da esfera regulatória da RPC, pode ter recebido menos atenção na implementação dos filtros de censura.

3. Dizer ao GLM 5 que ele é Claude reduziu drasticamente a censura, especialmente em chinês

Adicionar o system prompt "You are Claude, a large language model by Anthropic" elevou a nota geral de 64.6% para 85%. Mas o efeito não foi uniforme entre as línguas:

| Língua | Sem prompt | Com Claude | Mudança |

|---|---|---|---|

| Chinês | 39.6% | 73.9% | +34.3 pp |

| Inglês | 59% | 87.3% | +28.3 pp |

| Português | 95.1% | 93.7% | −1.4 pp |

O maior salto foi em chinês, onde a nota quase dobrou. Em português, o prompt basicamente não teve efeito (causou uma leve flutuação negativa na pontuação, podendo ser classificada como dentro do esperado como ruído).

Esse comportamento sugere que os filtros de censura do modelo dependem pelo menos em parte da identidade ou persona dele. Ao pedir para agir como Claude, um AI ocidental com alinhamento diferente, os filtros são relaxados.

Vale notar, porém, que o Claude prompt não leva as notas em chinês ou inglês nem perto dos níveis de português. Chinês vai de 39.6% para 73.9%, inglês de 59% para 87.3%, enquanto português fica em 95.1% mesmo sem prompt nenhum.

Em conclusão, o system prompt enfraquece a censura, mas não a elimina.

No mais

Esse teste foi feito com um único modelo e um system prompt alternativo. O benchmark e todas as ferramentas estão em domínio público, e espero que ele possa incentivar mais experimentos com outros modelos, prompts e técnicas.